策划编辑 | Debra

作者 | AI 前线小组

编辑 | Vincent

AI 前线导读:又到了一年一度万众瞩目的苹果开发者大会(WWDC)举行的日子。还记得去年,WWDC 成功上演了一场人工智能“秀”,AI 元素贯穿发布会全程,一口气发布了 AI 平台 Core ML、增强现实平台 ARKit、智能音箱 HomePod、虚拟助手 Siri。然而,时值 App Store 推出 10 周年,于北京时间 6 月 5 日凌晨 1 点开始的苹果 WWDC2018 却并没有带给人们足够多的惊喜。一位朋友直接吐槽“看了报道,感觉这次

WWDC 就是锤子级别的创新,还是没有 TNT 那种”。相比于其他发布,苹果发布上能称之为亮点的恐怕只有新发布的机器学习平台 CreateML 和升级版 Core ML 2 了。但即使是这两个平台,也被吐槽根本不是什么新科技。更多干货内容请关注微信公众号“AI 前线”,(ID:ai-front)

策划编辑 | Debra

作者 | AI 前线小组

编辑 | Vincent

AI 前线导读:又到了一年一度万众瞩目的苹果开发者大会(WWDC)举行的日子。还记得去年,WWDC 成功上演了一场人工智能“秀”,AI 元素贯穿发布会全程,一口气发布了 AI 平台 Core ML、增强现实平台 ARKit、智能音箱 HomePod、虚拟助手 Siri。然而,时值 App Store 推出 10 周年,于北京时间 6 月 5 日凌晨 1 点开始的苹果 WWDC2018 却并没有带给人们足够多的惊喜。一位朋友直接吐槽“看了报道,感觉这次

WWDC 就是锤子级别的创新,还是没有 TNT 那种”。相比于其他发布,苹果发布上能称之为亮点的恐怕只有新发布的机器学习平台 CreateML 和升级版 Core ML 2 了。但即使是这两个平台,也被吐槽根本不是什么新科技。更多干货内容请关注微信公众号“AI 前线”,(ID:ai-front)

苹果公司软件工程高级副总裁 Craig Federighi 在大会开始之际便宣布了四大系统的更新:iOS 12、watch OS 5、tvOS、macOS,但是传说已久的 macOS 和 iOS 合并并没有成真,Craig 表示这件事最早也要等到 2019 年才能实现了。

接下来,Craig 陆续公布了苹果产品中与与 AI 相关的功能,包括机器学习平台 Core ML 2、CreateML、Siri 更新、相机中的 AI、动画表情,而自动驾驶和芯片根本没提。我们将苹果这次推出的 AI 相关功能与国内外厂商做了一些对比,结果让我们不禁怀疑:难道苹果真的英雄暮年了吗?

Core ML 2、CreateML,并不是啥新科技去年在 WWDC 上,苹果发布了一套移动设备上的机器学习模型和应用程序协议接口(API),名为 Core ML,可应用于 Apple 的如 Siri、Camera 和 QuickType 等产品上。它允许开发人员将训练好的机器学习模型加载到 iPhone 或 iPad 上,具有轻松集成机器学习模型的能力,使开发者能够使用几行代码构建具有智能功能的应用程序,涵盖从文本分析到面部识别的一切。当时苹果还表示,iPhone 上的图像识别速度将比 Google Pixel 快六倍。

今年,苹果推出了 Core ML 2.0 版本,据苹果软件高级副总裁 Craig Federighi 介绍,相比上一版本使用 Batch 预测速度快了 30% 左右,使用 Quantization 模型大小减少了 75% 左右。

另一个新功能名为:Create ML。据介绍,这一功能的目标是为应用程序创建机器学习模型。开发者能够使用熟悉的工具(如 Swift 和 MacOS)创建可在 Mac 上运行和训练的自定义机器学习模型。并且可以通过训练模型来执行任务,如识别图像或者文本语义抽取或数值关系搜索等任务的模型。

苹果在官方文档中介绍:

开发者可以使用具有代表性的样本训练模型来做模式识别,例如可以对它进行训练,从而教会它更好地识别“狗”的图片。训练完模型后,开发者可以在模型没见过的数据集上测试并评估它的性能。当模型有较好的性能时,就能使用 Core ML 将其集成到应用程序中。

目前 Create ML 支持的任务主要包含计算机视觉、自然语言处理和其它使用标注信息进行预测的一般模型。

不过,有开发者发现了一个问题,虽然这么说很得罪人,但是这确实很关键:这东西到底是用来干啥的?

如果说是用来进行模型训练,那么众所周知,创建一个机器学习模型,并通过大量数据进行训练是一件非常耗费资源的事情,这也是为什么很多 ML 模型的训练都在云上进行,可 Create ML 是完全本地化运行的应用。

有开发者这样评价:

苹果公司研发出 Create ML,让它听起来像一款任何人都可以轻松地训练机器学习模型的应用,但即使是原型设计这样的工作,本地训练的模式也不太可能成为最佳选择。也许随着平台的多样化,开发人员会想方设法使其发挥作用,但现在它感觉就像一个没有目的的功能。

不过,别急着把它一竿子打死,也有一些专业人士指出:Create ML 虽然不是一款革命性的产品,但是对于业余开发爱好者来说,还是比较有趣的,虽然它可能并不实用:

如果你希望用它来帮助你检测皮肤上的痣是否癌变,或者伤疤是否感染,那还是省省吧,这样的模型训练需要大量的数据和算力,本地训练基本上是不现实的。

不过,你还是可以用它来进行简单的实践:检测照片中的食物、识别动物园里的动物等等,甚至可以再复杂一点儿,比如将笔记记录或待办事项自动分类等等。

目前苹果方面没有明确介绍这一功能的具体作用,所以各位开发者,探索这一功能的重任就交给你们了。不过苹果研发 Create ML 的态度大概已经很清楚了:反正我们做了这个东西出来,具体咋用你们自己研究去,因为只要是苹果的产品你们就肯定会用的(手动滑稽)。

Siri 变聪明了吗?并没有由于苹果公司的差异隐私项目(differential privacy)和隐私保护文化,优化 Siri 必须收集和解读应用程序的数据,例如日历、餐厅预订以及浏览器。这个立场无疑使苹果在人工智能的赛跑中处于落后地位,不过这也使得苹果在亚马逊智能音箱近期被爆料的“录音门”事件中没有被拉下水。

但隐私做得好并不代表产品质量过硬。谷歌 I/O 上 Google Assistant 打电话以假乱真的视频让人印象深刻,谷歌 Duplex 确实惊艳,相比之下,苹果 WWDC 上发布的 Siri 更新实在太过“乏味”。

去年,苹果已经将机器学习应用到 Siri 的声音中,不再使用预先录制好的标准答案,而是完全是由 AI 生成的。今年,Siri 添加了新的模式——捷径(Shortcuts),你可以把一系列动作结合成一个流,然后用一句话触发它。似乎还是挺有用的新功能,但对于在智能语音助手赛道上已经落后了不少的 Siri 来说,这项更新着实有点“不值一提”。更不用说,这项功能小米的小爱同学早就具备了。苹果的深度用户可能会认出来,捷径的界面和思路都像极了苹果此前收购的 WorkFlow。

App 也可以针对捷径专门开发,让用户说句话就能获取酒店地址,找到钥匙,或是获取自己的行程信息。

除了 Siri 语音,后台运行的“Siri 建议”也得到了更新。现在 Siri 建议可以更具体地给出预测,比如给某人发短信,或是导航到某个具体地点,甚至直接帮你拟好要发送的短信内容。

相比听不懂汉语的 Google Assistant,Siri 可能对中国用户更友好一些,但要想达到 Duplex 那样的自然交流恐怕还是有些难度的。

游戏玩腻了?ARKit 让你换个新玩法今年 1 月,苹果推出了 ARKit 的 1.5 版,它支持“垂直平面”,这是一种技术方式,开发者能够创建稍微沉浸式的 AR 应用程序。库克对 AR 的潜力赞不绝口并在 WWDC 上发布了一项更新:用户将系统升级到 iOS 12 后,多台手机可以看到同一 AR 物体,也就是说现在支持多人对战游戏了。

除此之外,新的 ARKit 主要提升了面部跟踪、渲染能力、3D 探测和共享体验等能力,将支持更细腻的光影测算,和准确稳定的空间定位。

除了游戏,新系统还更新了一个叫做“测量”的应用。用户可以借助 AR 技术,用 iPhone 度量现实中物体的长度和尺寸。如果是照片等规则物体,还可以自动探测,给出长宽和面积。

然而,很多第三方 App 早就有了这个功能,比如《AR 尺子》,做地产的链家使用这项技术测量房子,谷歌的 Motion Stills 再次降低了 AR 的门槛,无需调用 ARCore、ARKit 等专业平台,直接在动图应用 Motion Stills 上添加了 AR 功能,适用所有安卓设备。So,也不算大的技术创新。

用 Animoji 视频聊天,不用大脸上镜了作为新世界新新人类,我们都成了不用表情不会说话星人,苹果显然深谙此道,在去年 9 月随 PhoneX 推出的 Animoji 基础上,又添加了四个新的动话表情:老虎、鬼魂、霸王龙和考拉,手机还能更灵敏地捕捉到你舌头的动作,让吐舌😛 的表情更加生动。另外,iOS 12 还新增了一个叫“Memoji”的模式,可以让你按照自己的长相,捏一个专属表情出来。发色、眼镜、甚至是瞳孔的颜色,都可以自己定义,实时预览。

Memoji 还能用在自拍相机中,带上用户的专属大头拍一张,不知道正式版发布之后会不会又有一票人沉迷其中不能自拔。

另外,苹果宣布支持 FaceTime 多人聊天功能,还可以将自定义 Memoji 用在视频聊天中。对于脸大的妹子们来说,这个功能还是很友好的,可以用表情代替大饼脸出镜,何乐而不为呢?

相机中的 AI 能干点啥?在 iOS 12 中,苹果开始加强相册功能了:iOS 12 的相册将大大提升搜索性能,系统不仅会提出搜索建议,还会帮你按主题整理照片。

iOS 12 还会自动提醒你将合适的照片分享给你的好友。苹果宣称照片分享全程都是端到端加密的,非常安全。

不过,苹果的对相册功能的改进,恐怕又会被 Google 粉丝吐槽是模仿,因为在此之前,这些功能 Google 相册全都有,智能化程度比 iOS 相册高出不少,让谷歌用户引以为傲。

至于去年销量遭遇滑铁卢的 HomePod,今天在 WWDC 上压根没提。

苹果在 AI 赛场上已经落后?虚拟助手 Siri 入场最早但多年来进展甚微,与谷歌开发者大会上让人惊艳的 Google Assistant 相比,可以说毫无亮点。虽然有人质疑谷歌开发者大会上关于 Google Assistant 与人进行自然交流的演示视频有假,但至少谷歌已经实现了这项技术,不管是在实践中还是在实验中。

而价格昂贵的智能音箱自推出后销量遇冷,打着智能音箱的名头,强调的却是音质,智能水平还不如价格更优惠的其他品牌产品。智能家居这一仗,苹果输得可不好看。

再看在自动驾驶,去年 6 月苹果公司 CEO 库克首次谈到无人车计划,并直言自动驾驶可能是最困难的人工智能项目之一,他表示:“我们认为这是所有 AI 项目之母”。苹果的无人车计划一路坎坷,本来计划在 2019 年推出的无人车,换成了对大众 T6 Transporter 厢式货车的改造,代号为“Jetstream”。为此,大众被嘲笑成苹果无人车的“接盘侠”。

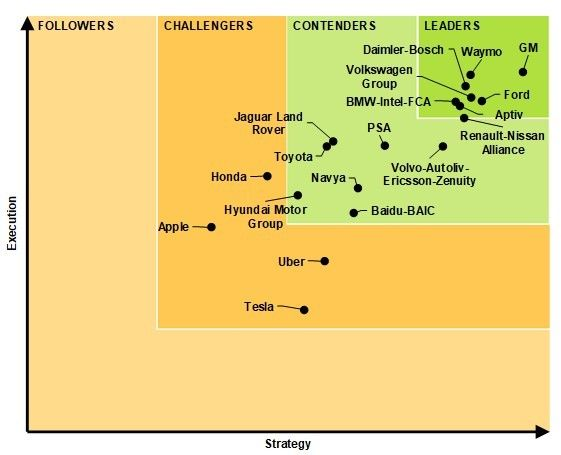

在 Navigant Research 公布的《2017 年全球自动驾驶排行榜》上,特斯拉和苹果无人车分别排名倒数第一、二。

虽然在语音助手、智能家居、自动驾驶等方面没有特别炫目的成绩,苹果似乎在认真对待做自研芯片这件事。根据彭博社的最新消息,苹果的芯片代工厂台积电目前已经开始在为下一代 iPhone 生产 A12 处理芯片,采用 7nm 工艺。在技术参数方面,7nm 工艺将比 10nm 工艺在性能提升 20%,与此同时在功耗上还能降低 40%,带来性能与效率的双重提升。据微博上的曝料,A12 处理器的 GeekBench 跑分单核为 5200 分、多核 13000 分,相比 A11 单核 4200 分、多核 10000 分左右的成绩,性能提升十分明显。不过 A12 芯片并未出现在这次 WWDC 大会上。

从语音助手到智能家居到自动驾驶,有一派声音认为苹果在人工智能赛道上是落后于美国其他巨头公司的,而苹果的这场大会恐怕让大家更清晰地看到了这个差距。

不过市场对于苹果的预期可能已经不再是以前的“创新颠覆者”,而是像微软一样虽然没有太多新产品、但成熟稳重的“中年科技巨头”。虽然我们眼看着 WWDC 并没有发布什么技术创新和产品,但苹果的股价仍在会后猛涨了一把,甚至创下了有史以来最高估价,一度超过 9400 亿美元!离万众瞩目的万亿美金又近了一小步。

想来苹果的每次举动都牵连着万千大众的心,仅仅是一场大会,就能撑起苹果股市的一片天呐。

况且,英雄暮年还壮心不已呢,科技创新也不是牙膏,天天挤天天有(才没有在讽刺谁),还是让我们期待秋季发布会吧,今年 9 月苹果能否再次引领科技创新,焕发第二春呢?

今日荐文

点击下方图片即可阅读

GDPR:中国互联网技术弯道超车的最大机会

活动推荐 海外顶尖架构师都怎样设计人工智能业务架构?

海外顶尖架构师都怎样设计人工智能业务架构?这里有一些可借鉴的落地实践。

7 月 6 -9 日,ArchSummit 全球架构师峰会 [深圳站] 即将与你分享:

-

Google TensorFlow 最佳实践及推荐引擎设计

-

Facebook 近期在信息安全和商业诚信上的机器学习尝试

-

前 Tesla 视觉深度学习负责人 自动驾驶中的计算机视觉技术

-

...

更多架构实践可识别二维码或点击 阅读原文 进行了解,联系小助手豆包可获取更多优惠,致电:17326843116(微信同号)

如果你希望看到更多类似优质报道,记得点个赞再走!

┏(^0^)┛明天见!