摘要:Yann Lecun曾将无监督学习比作蛋糕,将监督学习比作蛋糕上的糖霜,声称我们仅懂得如何做糖霜却不知道怎样才能做出蛋糕。在本篇文章中,我们提供了一份训练无监督学习算法的“蛋糕”配方,用来增强卫星图像。

以下为译文:

Yann Lecun曾将无监督学习比作蛋糕,将监督学习比作蛋糕上的糖霜,声称我们仅懂得如何做糖霜却不知道怎样才能做出蛋糕。在本篇文章中,我们提供了一份训练无监督学习算法的“蛋糕”配方,用来增强卫星图像。

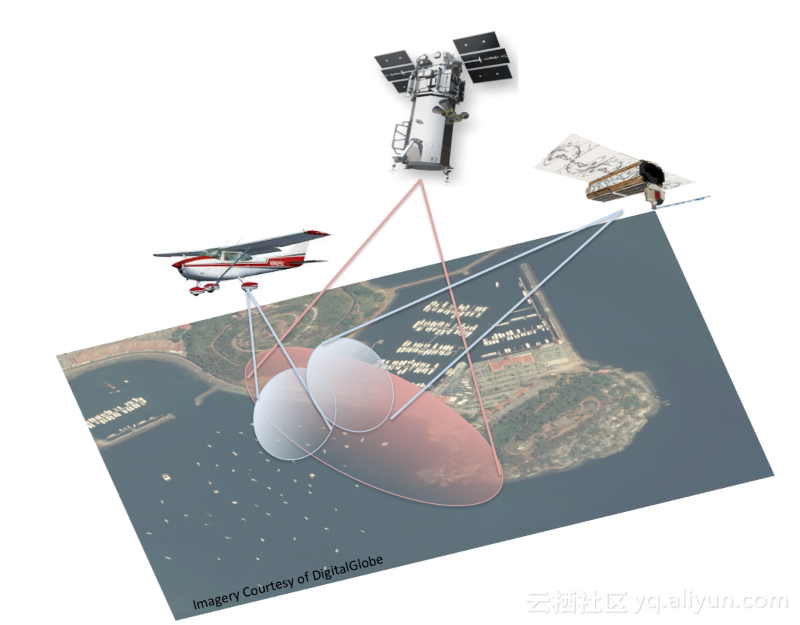

本研究起源于新兴商业航天行业中日益增多的低成本卫星图像。在这个新兴的行业中,传感质量、回访速率以及成本间存在着一种权衡。我们研究了高级图像处理的特性,以减少这种权衡,并在相同成本情况下改善低质量传感器返回的图像。

我们在深度神经网络(DNN)中嵌入高分辨率图像的图像细节,并在增强地理相似图像时抽取这些细节。作为本研究的一部分,我们引入了适合图像增强任务的扰动层,为深度神经网络开发了一种新型架构。

超分辨率技术

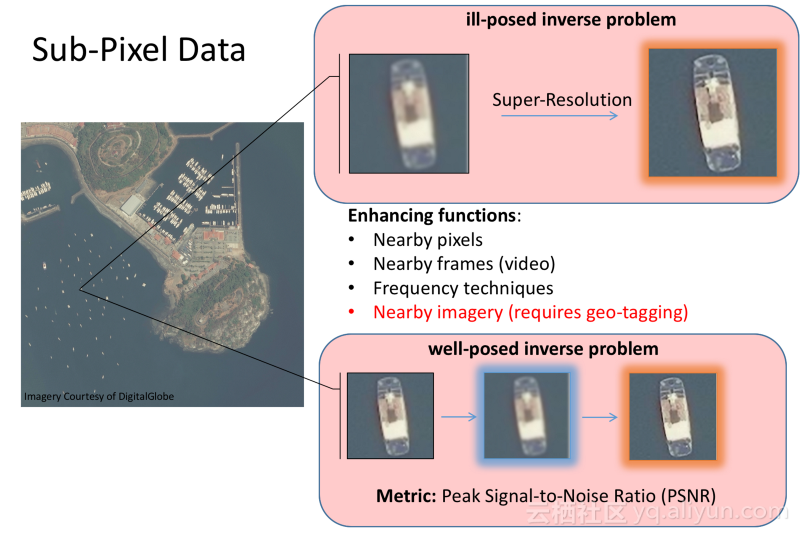

图像增强的方式有很多,如降噪和色彩调整。对于卫星图像而言,地面采样距离(GSD)是一种常见的衡量图像质量的方法,其表示图像中单个像素表示的实际物理距离。本文提到的图像增强是指降低(优化)卫星图像中的地面采用距离,即超分辨率技术。超分辨率技术通过合成图像中的子像素信息,提高图像分辨率。常见的合成方法包括:

图像中相邻像素间插值

影像中相邻帧间插值

频域滤波,降低噪声

在本研究中,我们对上述方法进行了扩展,在处理地理相关图像时应用深度学习技术。

为量化增强方法的效果,我们比较了图像增强前后的峰值信噪比(PSNR)。此外,针对后续的分析,我们还展示了图像中峰值信噪比的地域分布以及相关性。

PSNR是衡量超分辨率算法生成能力的必然选择。我们未来将发表一篇文章,使用生成对抗网络为超分辨率技术学习一种更好的代价函数。

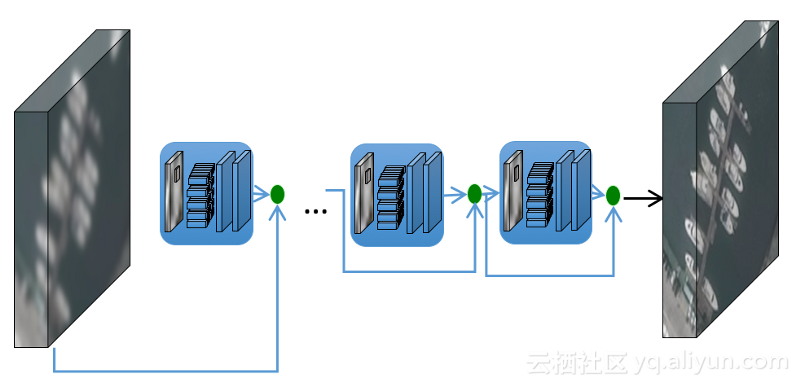

含扰动层的完全卷积神经网络

在直接展示结果前,我们先讨论下为执行超分辨率处理流程而开发的框架。标准的深度神经网络,如AlexNet、ResNet、VGG与GoogLeNet,都是对低分辨率图像进行图像分类与目标检测的框架,在输出空间达到指数级大小的超分辨率图像场景下并不适用。

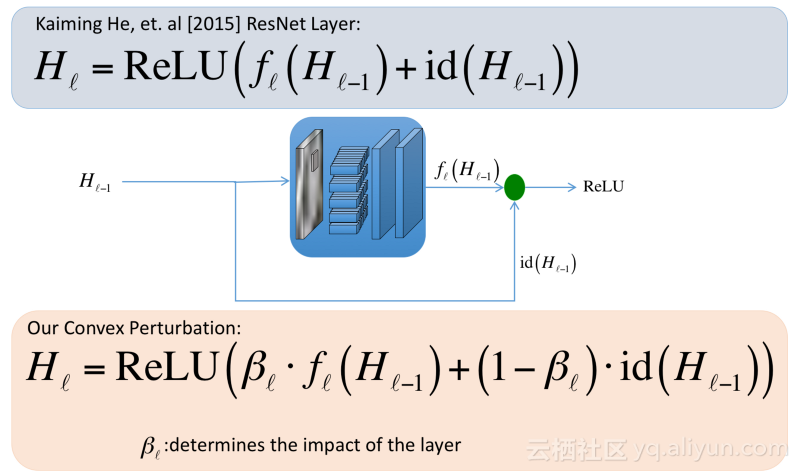

考虑到超分辨率技术本质上是低分辨率图像的一种扰动,我们受到ResNet的启发,决定设计一种新的、由恒等映射扰动序列构成的深度神经网络。这种网络通过优化前一层与当前层的凸组合来扩展自身结构,每次仅扩展一层,并产生可训练参数(旁路参数),衡量新层次对最终输出的贡献。

这种结构有以下好处:

这种网络架构很适合包含跳跃连接和随机深度的极深神经网络的训练,符合现代训练策略

旁路参数评估每一层的贡献,就网络应达到的深度给出反馈

每一层均执行近似恒等变换,使用不同结构增强图像

每个扰动层至少包含两个卷积层,每个卷积层间还包含一个非线性ReLU层。扰动层中更多的卷积层提高了扰动层增强图像的能力,但训练收敛也变得更加困难。另外,额外的扰动层具有类似的图像增强潜力,且不存在收敛问题。

旁路参数就每个扰动层的影响提供了直接的反馈。这些反馈有助于解答神经网络的深度应达到多少的问题。

实验

我们初步进行的实验使用了巴拿马运河3波段的GeoTIFF降质图像,通过增强降质图像来评估深度神经网络的图像增强能力。我们在实验中使用了两张由DigitalGlobe提供的GeoTIFF图像(非常大的卫星图像):一张用于训练,另一张用于测试。在一次深度神经网络计算中,我们并没有选择增强整张图像,相反,我们每次增强一个27x27像素大小的图像区域。由于GeoTIFF图像非常大,抽取27x27像素区域的方法能够为我们的深度神经网络提供充足的训练数据。更多的训练图像或许可以提高实验效果。但在下面的实验中,我们使用这两张GeoTIFF图像训练深度神经网络:

这两张GeoTIFF图像的大小进行了调整,已有效地降低了图像分辨率

采用随机抽样的方法,从第一张GeoTIFF图像中获取样本,训练深度神经网络,每次训练仅训练模型中的一层。我们训练深度神经网络中的权值,最大化深度神经网络输出的PSNR值

深度神经网络用于增强两张降质的GeoTIFF图像

实验结果将与基于插值的图像增强算法进行比较

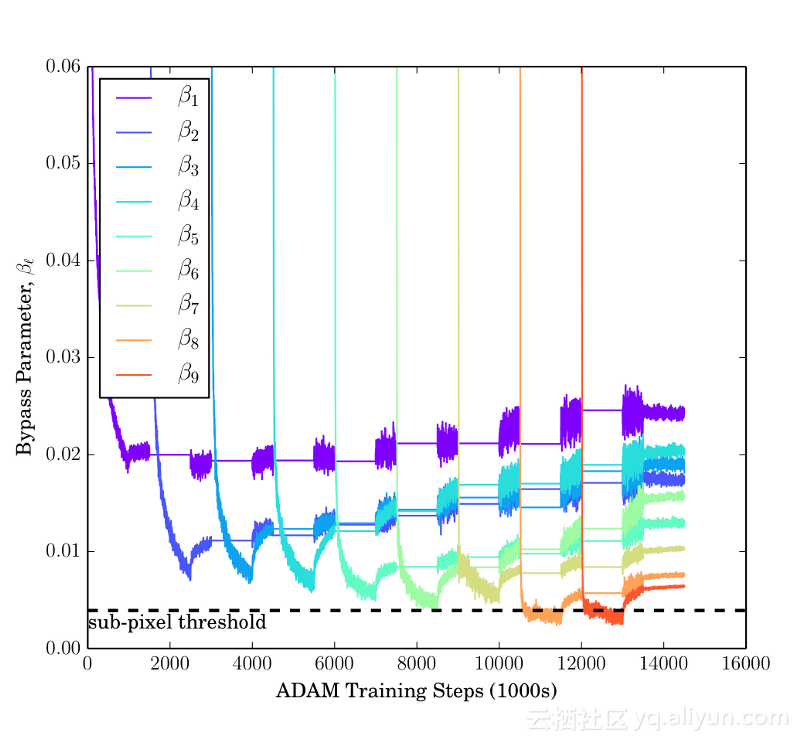

我们在一台2015年推出的装有4块Titan X显卡的NVIDIA Devbox机器上,使用TensorFlow来创建、训练、推断深度神经网络,但是在实际训练时,仅使用1块显卡用于训练。为训练神经网络,我们采用了最优化算法ADAM,ADAM关联了能够影响训练时间和收敛速度的参数。我们并未充分探索ADAM参数的最优选择,但仍然花费大约12个小时(使用一块Titan X显卡)的时间来训练每个扰动层。旁路参数的收敛速率(如图5所示)为我们选择ADAM参数乃至后续的训练时间上提供了帮助。

实验结果

在本次实验中,我们使用了两张关于巴拿马运河的GeoTIFF图像,一张用于训练,另一张用于测试。

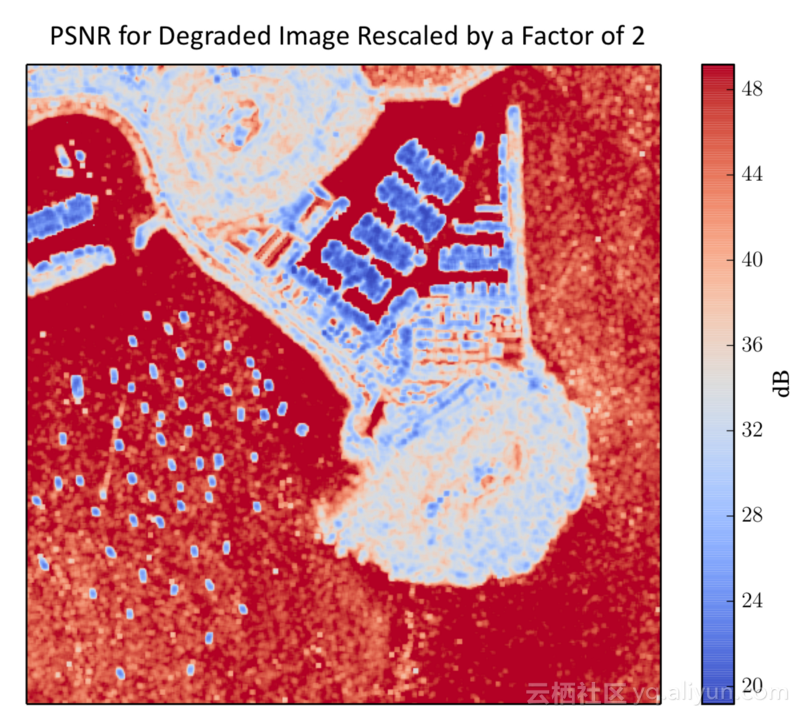

首先是通过GeoTIFF降质图像来创建训练数据。通过调整GeoTIFF图像的大小,最终生成的降质图像在GSD与分辨率上实现了有效的降低。使用线性插值作为起点,我们可以绘制PSNR在整张降质图像上的分布。

图7表明,仅一个表示PSNR的数字并不足以描述卫星图像中的噪声。在降质图像中,具有更多结构的区域,例如船只,相比于自身结构较少的区域,如水域,具有更低的PSNR值。当我们训练超分辨率算法来增强降质图像时,我们想要增强我们关注的区域,而这通常是含有结构的区域。

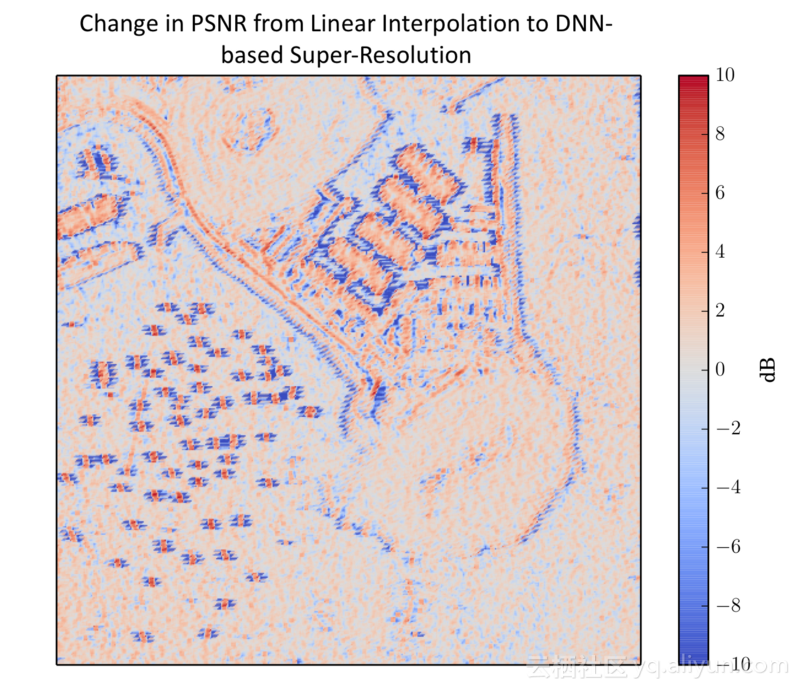

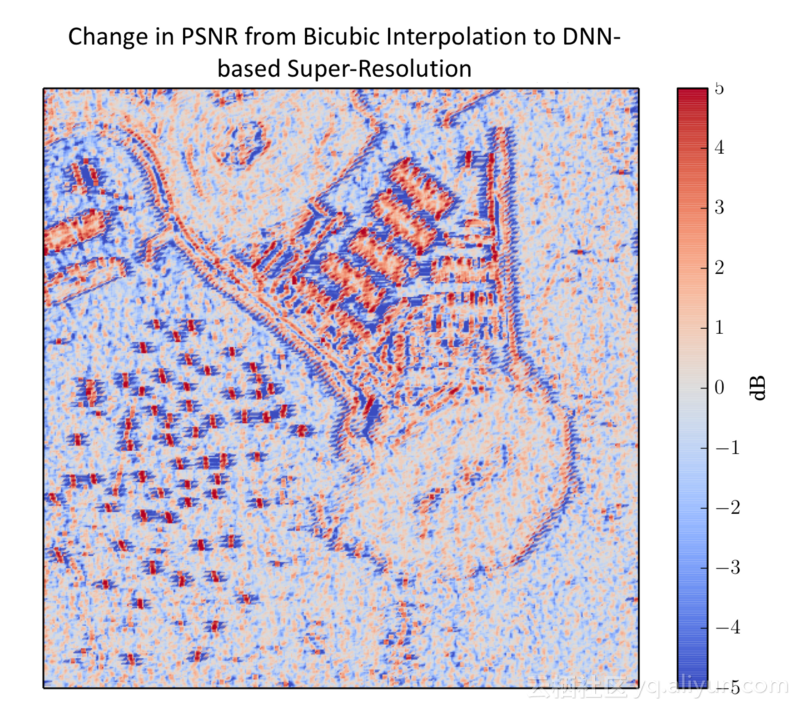

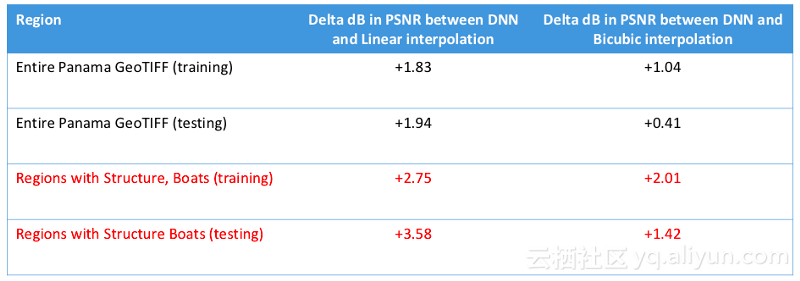

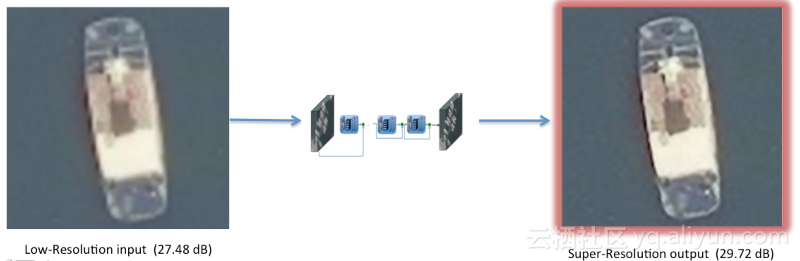

图10中的结果表明,基于深度神经网络的增强方法能够明显改善含更多结构的区域。尽管测试图像与训练图像具有相同的GSD,但不同的大气条件与云层覆盖也影响着增强的效果,这在一定程度上解释了测试图像性能优化高于训练图像的原因。图像清晰度也会影响到含船只区域的标记,不准确的标记可能含有更多的水域,进而降低在该区域的收益。避免了这些干扰的实验超出了本篇文章的讨论范围。

其他研究方向

包括SRCNN在内的一些示例,将超分辨率技术应用于非卫星图像,并在ImageNet上训练时取得了类似的增强效果。这些方法用于卫星图像增强或许是可行的,但我们提出的方法具有一个根本优势:图像的位置信息。此外,基于以下几点,我们提出的方法是不同与现有方法的:

卫星图像往往是许多基于深度神经网络的机器学习算法应用的极端情况

过度训练并不一定不利于我们的算法,我们可以得到更具多样性的图像数据集

扰动层提供了关于深度神经网络需达到的深度以及增加网络深度预期的边际性能改善的信息

除了红色、绿色和蓝色,GeoTIFF图像能够包含更多的颜色通道,针对额外的颜色通道(例如8波段图像),我们的方法只需进行简单地修改就可使用

最后,我们对扰动层中卷积层的数量进行了实验,增加每个扰动层中卷积层的数量,并查看提高的性能。我们将在第二部分展示这些实验结果,这些实验基于8波段图像和SpaceNet数据集。

文章原标题《Super-Resolution on Satellite Imagery using Deep Learning, Part 1》,作者:Patrick Hagerty

文章为简译,更为详细的内容,请查看原文:The official blog of CosmiQ Works in Medium

本文由阿里云云栖社区组织翻译。